LLMのファインチューニング入門として、本記事では汎用言語モデルを自社業務に特化させるための追加学習手法を解説します。実務的には、月3万円程度の予算とデータ50件から始めることができるため、システムエンジニアでなくても実装可能です。多くの担当者が「難しい技術」「高額投資が必要」と身構えていますが、実際には段階的な環境構築と適切なデータ準備により、中小企業でも業務特化AIを実現できます。本記事では、環境構築のつまずき、データセット準備、学習パラメータ調整、運用まで、現場で必要となる知識をすべて解説します。

ファインチューニングが業務特化AIの最短手段になる理由

ファインチューニングとは、事前学習済みの大規模言語モデル(LLM)に対して、自社の特定データセットを用いて追加学習を行い、特定のタスクや業界用語に最適化するプロセスです。ChatGPTやClaudeのような汎用モデルは一般的な知識には優れていますが、自社固有の業務ルール・専門用語・データ形式には対応できません。

例えば、製造業の品質管理を担当する場合、汎用モデルに「この部品の寸法公差を判定してください」と指示しても、社内規格書に書かれた細かい判断基準までは学習していないため、外部サーバーにデータを送信する必要が生じます。これに対してファインチューニングを実施すれば、自社データだけで学習を完結させ、モデルをローカル環境で実行できます。結果として情報セキュリティ・応答速度・コストの3点が同時に向上するのです。

| 項目 | 汎用モデル(RAG活用) | ファインチューニング後 |

|---|---|---|

| 外部API呼び出し | 毎回発生 | 不要 |

| 応答時間 | 数秒 | 100ms程度(7Bモデル、A100推論時) |

| データ流出リスク | 高い(プロンプトに含まれる) | 最小(学習後はローカル実行可) |

| 月額コスト | 業務量に応じて増加 | 固定(ハードウェア償却のみ) |

| 専門用語対応精度 | 低い | 業種・企業ごとに高い |

実際に、京谷商会のAIソリューションズ部門では、営業事務の提案書自動生成やメンテナンス記録の分類タスクでファインチューニングを検証しており、汎用モデル+プロンプト調整だけではカバーしきれない細かい業務ロジックをモデル自体に埋め込む効果を確認しています。過去の実績記録100件程度のデータセットでも、実務レベルの精度改善が見られるパターンが多いです。

ハードウェア選定で失敗しない実装戦略

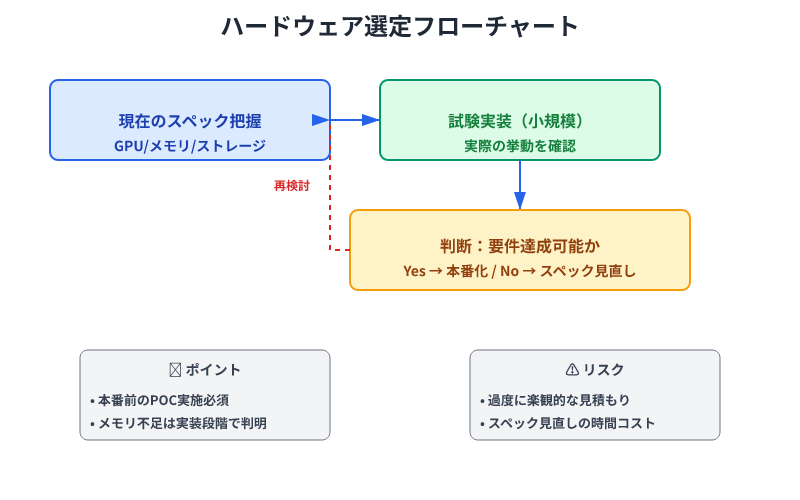

ファインチューニング導入時の最初の落とし穴は、ハードウェアスペック選定での過度な慎重さまたは楽観視です。多くの企業担当者は「RTX 4070(VRAM 12GB)とメモリ32GBで十分か」という質問を抱えながらも、実装段階ではじめて「試してみないと分からない」という不確実性に直面します。この判断の曖昧さが、多くのプロジェクトを破綻させるのです。

実務的には、以下の表を参考に「最小構成で試す→スケールアップ」というアプローチを取ることが重要です。ただし表中の「学習時間(10000サンプル)」は目安値であり、実際には使用モデルサイズ・データセット行数・バッチサイズによって大きく変動します。

| モデルサイズ | 必要GPU(VRAM) | メモリ | 学習開始に必要なサンプル数 | 学習時間(参考値) |

|---|---|---|---|---|

| 70億パラメータ | 8GB以上 | 32GB | 50~500件 | 30分~2時間(A100推論環境) |

| 130億パラメータ | 24GB以上 | 64GB | 100~1000件 | 1~4時間 |

| 350億パラメータ | 80GB以上 | 128GB | 500~5000件 | 4~12時間 |

多くの中小企業業務では、70億~130億パラメータのオープンソースモデル(Llama 2、Mistralなど)で十分です。むしろ重要なのは品質の高い学習データセットであって、パラメータ数ではありません。初期段階では月3万円程度のクラウドGPUレンタル(Google Colab Pro / Lambda Labs / RunPod)で試行し、定期運用が確定してからオンプレミス投資を検討するほうが賢明です。このアプローチにより、失敗時のコスト損失を最小化し、導入期間を短縮できます。

環境構築エラーの段階的な解決方法

「Google Colabで立ち上がらない」というエラーは、実装者の大半が経験するポイントです。原因の大多数は環境のバージョン依存性に起因しており、PyTorch・Transformers・PEFTといったライブラリのバージョン組み合わせが少しずれるだけでビルドが失敗します。

環境構築時のよくあるエラーメッセージと対処法を以下に示します。実装初期の最優先タスクは、具体的なエラー文を記録し、根本原因を特定することです。AIに丸投げせず、エラーメッセージの「具体的なライブラリ名」「バージョン」「実行コマンド」の3つをセットで整理してから相談することで、回答精度が大幅に向上します。

よく見かけるエラーメッセージと対処:

CUDA out of memory が出た場合、バッチサイズを現在の値から半分に減らし、再実行してください。例えば batch_size=8 から batch_size=4 への変更で、メモリ使用量はおおむね60~70%に低下します。同時に、max_sequence_length を512から256に減らすことでもメモリ圧力が緩和される場合があります。

ModuleNotFoundError: No module named 'transformers' は、PyTorchはインストール済みだがtransformersライブラリが未インストールの状態です。pip install transformers==4.30.0 を実行し、PyTorchと互換性のあるバージョンを明示的に指定してください。

RuntimeError: CUDA is not available は、GPUドライバーとCUDAのバージョン不一致が原因です。最初のアクションは nvidia-smi コマンドでGPU認識を確認し、Nvidiaの公式互換性表でインストール済みCUDAバージョンの確認です。Google Colabの場合は環境が自動で提供されるため、ローカル環境での発生に限定されます。

環境構築時のチェックリストとして、以下の順序で実施することで、エラーの大半を事前に防ぐことができます:

- Python 3.10以上のバージョン確認(

python --version) - GPUドライバーとCUDAバージョンの対応確認

pip install -r requirements.txt実行後、python -c "import torch; print(torch.cuda.is_available())"でGPU認識確認- ローカルテスト用の小さなデータセット(100件程度)で実際に学習スクリプトを1回実行し、本データセットに進む前にエラー箇所を特定

学習データセット準備の現実的な3つのステップ

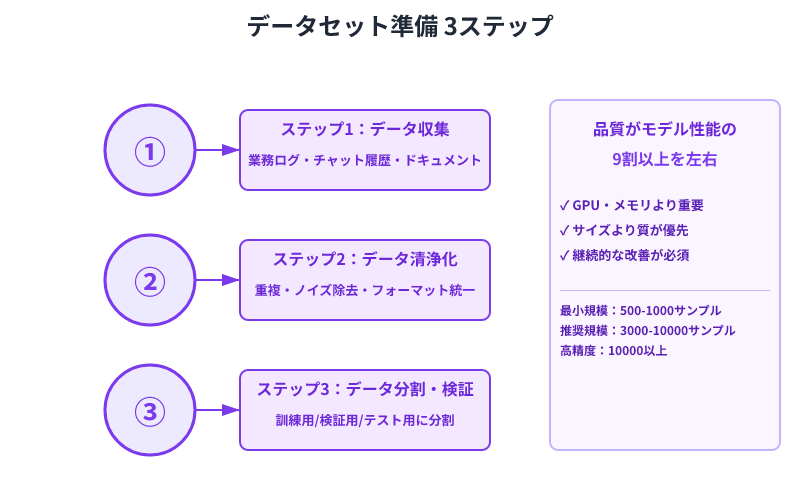

ファインチューニングの成否はデータセット品質の占める割合が9割を超えます。これはモデルの大きさやGPUスペックよりも影響が大きい事実です。

まず理解すべきは、ファインチューニング用データセットの形式です。一般的にはJSONL(JSON Lines)形式で準備され、次のような構造を持ちます:

{"instruction": "提案書のタイトルを決めてください", "input": "商品:SaaS契約管理ツール、対象:EC企業CTO", "output": "契約管理の属人化を解消する——クラウドネイティブなワークフロー自動化を実装する案件提案書"}

{"instruction": "提案書のタイトルを決めてください", "input": "商品:RPA導入支援、対象:製造業経営層", "output": "月100時間の工数削減を実現する——ロボティック・プロセス・オートメーションの導入ステップ"}

動作確認環境:Python 3.10 / PyTorch 2.0 / transformers 4.30

ステップ1:既存データからのサンプル抽出

自社で過去に実施した業務の記録(メール、提案書、会議記録)から、良い例と悪い例を50件ずつ集めます。品質基準は「新入社員が見たときに判断ロジックが明確かどうか」という一点です。この段階では完璧さを目指さず、実装可能な規模から開始することが重要です。

ステップ2:データの均衡化

例えば営業提案の分類タスクなら、「高確度」「中程度」「低確度」の3カテゴリが1:1:1の比率になるように調整します。片寄ったデータセットでファインチューニングすると、モデルが多数派のカテゴリに偏ってしまう現象が起きます。これを回避するため、各カテゴリの件数が可能な限り均等になるようサンプリングしてください。

ステップ3:テストセット分離

500件のデータセットなら、450件を学習用、50件をテスト用に分割します。学習後にテストセットで精度を測定することで、過学習(モデルが学習データに過度に適応し、未見のデータに対応できなくなる状態)が起きていないか確認できます。

実装経験としては、「完璧なデータセットを目指す」のではなく「50~100件の高品質サンプルで試す→精度測定→必要に応じて拡張」というアプローチを強く推奨します。データ量を増やすだけで精度が向上するケースは実は少なく、むしろ既存の50件のクオリティを高めることのほうが重要です。

実装段階での学習パラメータ調整——試行錯誤の時間短縮法

ファインチューニング実装時に「どのパラメータを使えばいいのか」という判断に多くの時間を費やすのは、その後の運用を大きく左右します。学習率(learning rate)、バッチサイズ、エポック数といった要素は、データセットごとに最適値が異なるためです。

よく見かけるのは「デフォルト値をそのまま使う」という判断ですが、実際には自社データセットの特性に合わせた微調整が不可欠です。例えば、提案書作成タスクなら1エポックで十分な場合もあれば、品質判定タスクなら3~5エポック必要な場合もあります。

現実的には、次の「参考値フレーム」から出発し、テストセットの精度を見ながら調整するのが効率的です。

| パラメータ | 推奨値 | 調整の見かた |

|---|---|---|

| Learning Rate | 2e-4 | 精度が上がらなければ5e-5に下げる |

| Batch Size | 8(GPU12GB時) | メモリ不足エラーなら4に下げる |

| Epochs | 3 | テスト精度が頭打ちなら2に減らす |

| Max Sequence Length | 512 | 入力テキストが短ければ256に設定 |

| Warmup Steps | 100 | データセット100件未満なら10に設定 |

この調整プロセスは「パラメータ探索」と呼ばれ、完全な自動化は難しい領域です。むしろ「月1回、テストセットで精度を測定→パラメータ1つだけ変更→結果を記録」という人間主導のサイクルのほうが、長期的な信頼性が高まります。AIに任せすぎると、かえって導入期間が延びてしまう現象が観察されます。

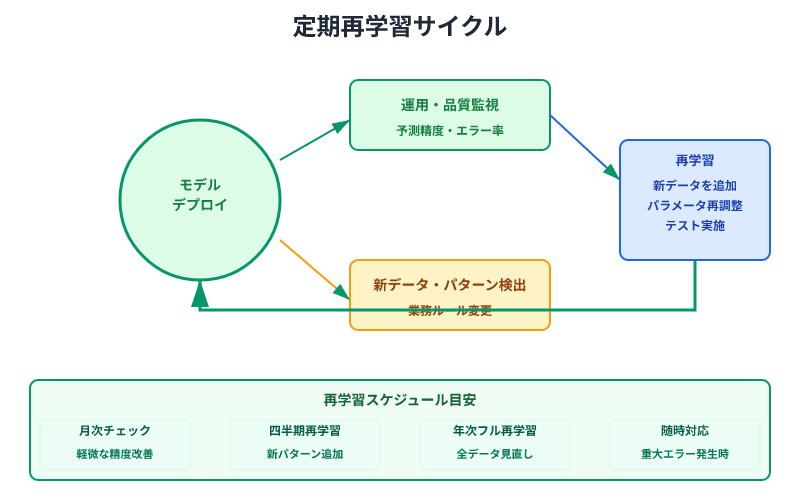

定期再学習による信頼性維持——業務品質を保つ運用体制

ファインチューニングを一度実施して終わりではなく、その後の定期的な再学習が業務品質を左右します。新しい業務パターンが増えたり、業界用語が変わったりすれば、モデルも適応する必要があります。

京谷商会のAIソリューションズ部門では、営業提案の自動生成モデルについて月1回のペースで再学習を実施する仕組みを現在検証中です。前月に実施した提案のうち「クライアント反応が良かった例」を学習データに段階的に追加することで、モデルの推奨内容が改善される効果を期待しています。この運用体制がなければ、初期の精度は高くても、半年後には時代遅れのモデルになる可能性が高いです。

再学習の実行判定基準として「新規業務が月20件以上増えたら実施」という明確なルールを設けることが重要です。その判定が曖昧だと、「そろそろ再学習したほうがいいのでは」という主観的判断に陥り、計画性が失われます。さらに、地方中小企業でこのような運用体制を構築する際に課題となるのが、IT人材の不在です。

IT人材不在の環境では、外部パートナー(クラウドベンダーやAIコンサルタント)との定期的な相談タイミングを最初から設定しておくことが有効です。例えば「3ヶ月ごとに再学習の可否を判定し、必要に応じてパートナーに学習スクリプトの実行と精度測定を依頼する」という形式で、ローカル人材不足を補完できます。また、ネットワーク環境の制約がある場合は、クラウドGPU環境での学習を最初から計画し、オンプレミス環境の構築を段階的に進める「ハイブリッド運用ロードマップ」の提示をパートナーから受けることで、導入リスクが大幅に低下します。

よくある質問

社内の極秘情報を学習データに含めてもセキュリティ的に大丈夫ですか?

ファインチューニングの最大のメリットがこれです。学習が完了すれば、モデルはローカル環境またはプライベートサーバー上でのみ実行され、データが外部に送信されることはありません。ただし「学習ファイルの管理」と「学習済みモデルの保管」は、通常のデータセキュリティと同じレベルで保護する必要があります。Linuxのファイルパーミッション設定、アクセスログの記録、定期的なバックアップが必須です。

ChatGPT のAPIとの連携は可能ですか?

可能ですが、用途が異なります。ファインチューニングは「独立したモデルの構築」を目指すもので、汎用モデル(ChatGPT)の精度向上を狙うものではありません。実務的には「機密性が高い特定タスク」はファインチューニングしたローカルモデルで、「汎用的な質問」はChatGPT APIで処理する二層設計が最適です。

小規模データセット(50件未満)でもファインチューニングは有効ですか?

有効ですが、期待値を下げる必要があります。50件程度なら「事前学習済みモデルを少し調整する」程度の効果に留まります。ただし、これでも汎用モデルと比べて業界用語や社内ルール対応が改善されるため、無駄ではありません。理想的には「最初の試行は50件で実施→精度測定→必要に応じて500件まで拡張」というステップを踏むほうが費用対効果が良いです。